ChatGPT як співавтор?

- Деталі

- Створено: Неділя, 18 серпня 2024, 11:17

- Перегляди: 2353

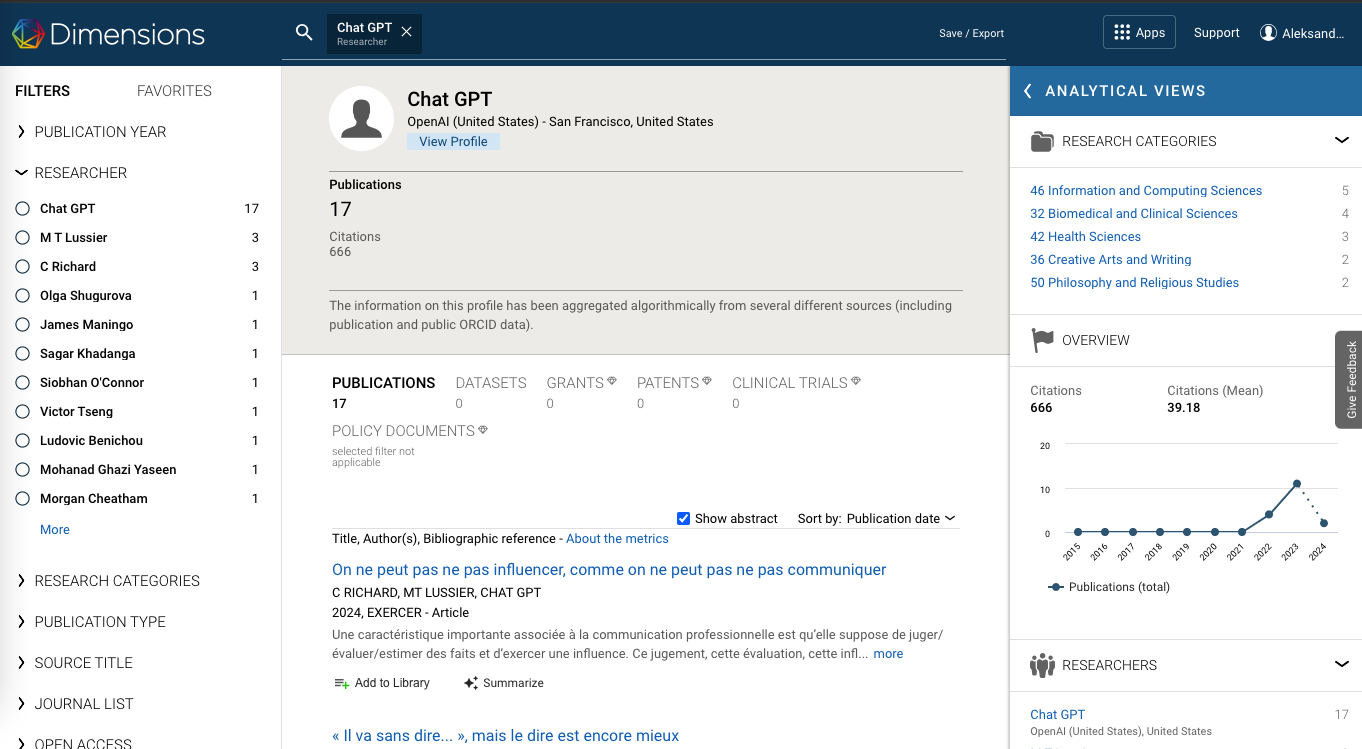

Через два місяці після запуску ChatGPT досяг 100 мільйонів активних користувачів, що зробило його на той час «найшвидше зростаючим споживчим додатком в історії». Серед перших користувачів були члени наукової спільноти.

На кінець 2023 року було опубліковано щонайменше чотири наукові статті, співавтором яких є ChatGPT (станом на серпень 2024 їх вже 17).

Одна із чотирьох під назвою «Rapamycin in the context of Pascal’s Wager: generative pre-trained transformer perspective» була опублікована, щоб створити прецедент для визнання потенціалу великих мовних моделей, таких як ChatGPT, робити достатньо «значущі внески» до наукової роботи для обґрунтування авторства. За іронією долі, як повідомляється в розділі «Внески авторів» журналу, коли автор Олексій Жаворонков запитав ChatGPT, чи слід включити його як співавтора, він відповів кількома переконливими причинами, чому цього не слід робити.

- GPT Chat, A. Zhavoronkov, Rapamycin in the context of Pascal's Wager: Generative pre-trained transformer perspective. Oncoscience 9 , 82–84 (2022).

Хоча насправді неофіційно існує безліч наукових праць, написаних у співавторстві дослідниками, які використовували ChatGPT та подібні великі мовні моделі у своїй роботі. Однак важливо зазначити, що ці праці не є результатом співавторства самого ChatGPT у традиційному розумінні, оскільки такі моделі штучного інтелекту, як ChatGPT, не мають авторських можливостей або намірів. Замість цього їх використовували як інструменти, що допомагають у складанні текстів, генеруванні ідей або аналізі даних. Ступінь визнання ChatGPT варіюється, причому в деяких роботах модель прямо згадується як авторська розробка.

Точну кількість таких робіт важко оцінити кількісно, оскільки це залежить від того, як визнається внесок ChatGPT. Тенденція використання штучного інтелекту в дослідженнях зростає, і, ймовірно, в майбутньому все більше робіт посилатимуться на допомогу ШІ. Так, у лютому 2023 року журнал PNAS оголосив про свою політику щодо ChatGPT і генеративного ШІ. У ній зазначено, що:

«Програмне забезпечення не може бути внесено до списку авторів, оскільки воно не відповідає критеріям авторства та не може розділити відповідальність за статтю або нести відповідальність за цілісність наданих даних».

Крім того, автори, які використовують програмне забезпечення штучного інтелекту для підготовки рукопису, повинні описати деталі його використання в рукописі, а також повинні визнати, що вони «несуть виключну відповідальність за результати, створені за допомогою генеративного програмного забезпечення штучного інтелекту, і повинні ретельно перевірити факти».

Хто несе відповідальність за помилки ШІ у текстах: автор, редактор, рецензент чи розробник ШІ?

Одне важливе застереження щодо технології LLM у написанні наукового тексту полягає в тому, що на цих ранніх етапах її використання при підготовці рукописів справді траплялися ненавмисні оказії, як, наприклад, коли автори не помічали випадкових фраз, залишених у тексті ChatGPT, які згодом можуть залишитися непоміченими рецензентами, редакторами чи коректорами та призвести до критики читачами опублікованих статей. Одну з таких фраз, «regenerate response», яка є назвою кнопки, яку потрібно натиснути, щоб наказати ChatGPT перезапустити роботу, знайшов комп’ютерний спеціаліст Університету Тулузи Гійом Кабанак у понад 30 опублікованих статтях.

Опис того, як ChatGPT використовується для проведення дослідження чи підготовки рукопису, підвищує прозорість, як і опис того, як використовуються інші інструменти (наприклад, статистичні пакети для аналізу даних). Повне розкриття інформації про використання інструментів штучного інтелекту також може допомогти науковому співтовариству навчитися розпізнавати та розуміти їх сильні сторони та обмеження. Ця точка зору лежить в основі останніх змін політики PNAS щодо використання штучного інтелекту, у заяві:

«Використання програмного забезпечення ШІ, такого як ChatGPT, для підготовки рукопису, включаючи складання або редагування тексту, має бути зазначено в розділі «Матеріали та методи» (або Подяки, якщо немає розділу «Матеріали та методи»).

PNAS (Proceedings of the National Academy of Sciences of the United States of America) — далеко не єдиний журнал, який пристосовується до генеративного ШІ як до нової сили у видавничій діяльності. На початку жовтня 2023 група редакторів журналів з біоетики та гуманітарних наук опублікувала «попередній набір рекомендацій щодо генеративного ШІ в наукових публікаціях»:

- G. E. Kaebnick et al., Editors’ statement on the responsible use of generative AI technologies in scholarly journal publishing. Hastings Center Rep. 53, 1–4 (2023), https://doi.org/10.1002/hast.1507.

Ці рекомендації схожі на ті, що розробляються та приймаються науковими журналами, та пропонують виключення генеративних інструментів AI або LLM зі статусу авторства та прозоре розкриття авторами інформації про використання цих інструментів. Вони також закликають до розробки методів ідентифікації створеного штучним інтелектом тексту, якщо автори не можуть задокументувати його використання, і завершують нагадуванням, що професійні норми найкраще розвиватися в контексті широкої громадської дискусії.

Ентропія: цитування цитат

Штучний текст – це статистичний набір людських цитат. Коли ми цитуємо ШІ, ми цитуємо цитати.

Спочатку експерти думали, що нам слід просто цитувати ШІ, як ми цитуємо інших авторів. Можливо, ми могли б використовувати одинарні прямі лапки для тексту штучного інтелекту або щось подібне. Але незабаром дослідники виявили, що розмітка взагалі не працює. Цитувати ШІ – це не те саме, що цитувати людей. Коли ми використовуємо штучний текст, ми не обов’язково цитуємо цілі речення чи абзаци. Це можуть бути окремі клаптики речень, словосполучень, слів, ідей, або редагування з допомогою ШІ цілого тексту.

Коли текст, створений штучним інтелектом, змішується з написаним людиною, їх стає важко відрізнити. Таке змішування ШІ та людської мови може ускладнити правильне визначення ідей. Потім ми змішуємо цю суміш з нашими власними словами. Чим більше людського та штучного тексту поєднується, тим менше тексту ШІ можна буде виявити. По суті, це більше схоже на співавторство, ніж на цитування. Тож, вказування ШІ як співавтора є достатньо відвертим та чесним жестом з огляду на те, що ідеї людини та машини поєднуються у фінальному тексті. Однак, це питання є риторичним, адже, як нам відомо, ШІ не є антропоморфним, а отже, не може мати власних ідей.

Однак, посилатися на ШІ варто у всіх випадках, коли ми використовуємо його як інструмент.

Якщо ви використовуєте штучний інтелект для допомоги з чернеткою тексту або планом роботи, вам слід вказати це на початку або в кінці документа, наприклад, так: «Цей документ було створено за підтримки Microsoft Copilot».

Якщо ви цитуєте розмову з інструментом штучного інтелекту як джерело або як об'єкт дослідження, користуєтеся чат-ботом, генератором зображень чи іншою системою штучного інтелекту, та використовуєте згенерований текст або зображення безпосередньо у своїй роботі, вам потрібно буде цитувати їх. Наприклад:

- Внутрішнє цитування

- «Ставлячи перед ChatGPT питання "чи допомагає ChatGPT академічній недбалості?", ШІ перекладає відповідальність на користувача, заявляючи, що "користувач сам вирішує, як використовувати ChatGPT, і він не призначений для використання в будь-яких мерзенних цілях, включно з академічною недбалістю"» (OpenAI, 2022).

- Запис у списку літератури

- OpenAI (2022). ChatGPT (версія GPT3). [Комп’ютерна програма]. Доступно за адресою: https://openai.com/blog/chatgpt/ (Дата перегляду: 13 грудня 2024 р.).

Якщо ви використовуєте інструмент штучного інтелекту для створення зображення, посилатися на нього можна так:

- Внутрішнє цитування «На рисунку 1 показано реалістичне візуальне моделювання на основі низки текстових підказок за допомогою інструменту AI» (Midjourney, 2023).

- Підпис до зображення «Рисунок 1 : Синтетичний ландшафт» (Джерело: Midjourney, 2023).

- Запис у списку літератури: Midjourney (2003) Синтетичний пейзаж [зображення]. Доступно за адресою: https://midgard.com/image-53461 (Дата перегляду: 18 вересня 2024 р.)

Визнання використання ШІ

Якщо ви використовували інструмент або технологію штучного інтелекту, наприклад ChatGPT, для створення результату, який ви або перефразовуєте, або прямо цитуєте у своєму тексті, ви повинні посилатися на цей результат як джерело у своєму списку посилань. Якщо ви використовували інструмент або технологію штучного інтелекту будь-яким іншим способом (наприклад, мозковий штурм, розуміння концепцій, генерування прикладів, узагальнення прочитаного), деякі установи просять заявити про те, як саме ви використовували інструменти чи технології штучного інтелекту. Наприклад, Університет Мельбурна просить всіх студентів додавати до своїх робіт таку заяву (декларацію) наприкінці всіх текстів, що йдуть на оцінювання.

Приклад 1

Я підтверджую використання Bing [Bing.com] для створення плану для есе. Я ввів такий запит: «План есе на 1000 слів про вплив технологічного розвитку на нерівність доходів в Австралії». Я використовував результати на початковому етапі завдання, щоб допомогти спланувати есе. Я змінив створений план, відкинувши кілька запропонованих основних абзаців і замінивши їх власними ідеями, заснованими на дослідженні та прочитаному мною.

Приклад 2

Я визнаю використання ChatGPT [https://chat.openai.com/] для обговорення тем для оцінювання. Я ввів такий запит: «Мозковий штурм ідей щодо теми [x]». Я використовував результат як відправну точку для початкового дослідження, перш ніж звузити тему для своєї роботи.

Приклад 3

Я підтверджую використання DeepL Translate [DeepL.com] для створення перекладів ключових термінів з англійської на мою рідну мову під час підготовки цього завдання. Я ввів такий запит: «окислювально-відновна (окисно-відновна) реакція». Я використовував результати, щоб краще зрозуміти тему під час дослідження.

Приклад 4

Я визнаю використання Grammarly, щоб допомогти мені переглянути мої письмові роботи на останньому етапі підготовки. Я використовував такі функції: Чіткість, правильність. Я використав такий запит: «Запропонуй способи зробити мої твори більш науковими». Я критично проаналізував відгуки, створені Grammarly, і на основі цього переглянув текст, використовуючи власні слова та вирази.